SoftBank Robot World 2017に参加してきました

pepperを最近触っているということもあり、外の会社がどういう感じで進めてるのかを調査しにSoftBank robot world 2017に行ってきました。

pepperだけでなくSoftBankが進めるロボット事業についても話があり、最近動画が話題の高い台からバック宙して見事に着地するロボットの話も出てきて、会場が湧きました。Boston Dynamics社とSoftBankが提携するようです。

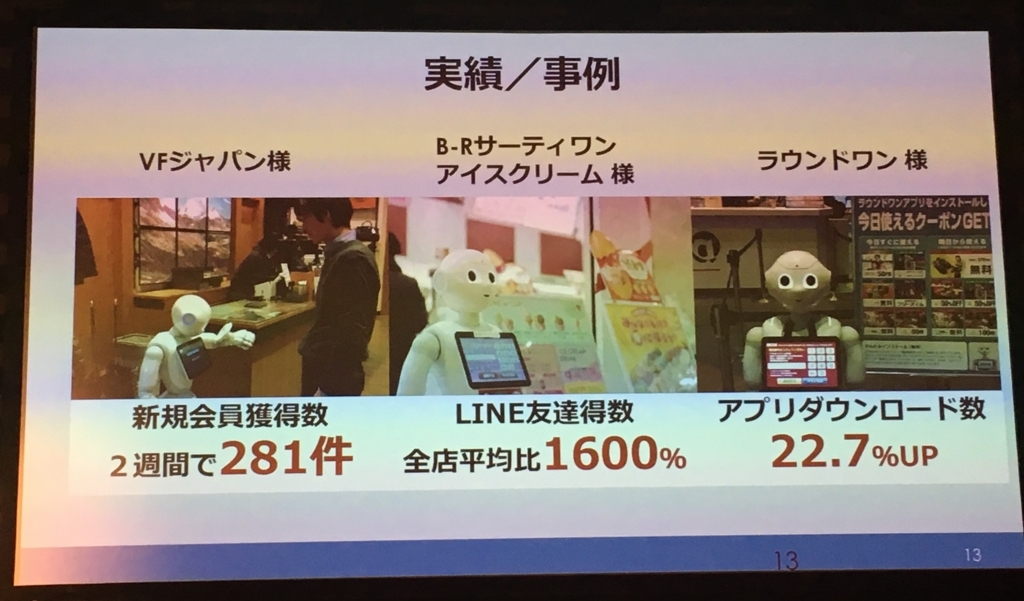

いくつか事例のセッションを聞いて感じたことは、人間の代わりとなってロボットがやったほうが利益がある業務があり、やってみないとわからないということ。

導入したものの投資対効果を出せない

とよく言われるそうですが、たしかにそうだなと感じます。

何か現行の人間がやっている業務をロボットに置き換えることで期待できることを考えた上で、導入前の実績値を取っておいて、導入後の値との比較をしっかりやらないといけません。

導入したからといって、必ず効果が出るわけではなく、効果が出るような作り込みが絶対必要です。

他の企業がやったから、うちでもうまく行くというものでもなさそうな気がします。

pepperがロボットだから人よりも○○しやすい。

というのは、あるかもしれませんが、○○しやすくても、操作性が悪ければ、途中でやめてしまいますし、その機能まで導くのも重要だと思います。

pepperのUIUXデザインパターンのようなものがあれば、ある程度全体的に統一されるとは思います。

うまくできてる企業は、なんとなくパターンみたいなのがわかってる気がします。

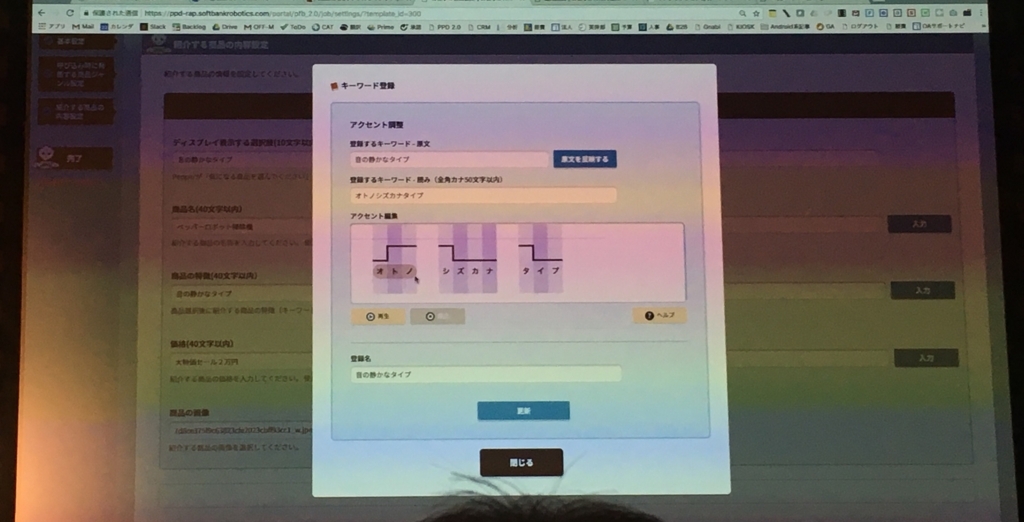

そうそう、昨日のブログで歌を歌わせるためにpepperが発する言葉の音程の調整が難しかったという話をしましたが、

それをちょっと解決してくれる機能が11/30にリリースされるお仕事かんたん生成2.0で追加されるとのことです。

GUI上で、音の高さを視覚的に調整してすぐに再生できるようです。

これがコレグラフで使える形で出力できればいいのですが、よくわかりません。

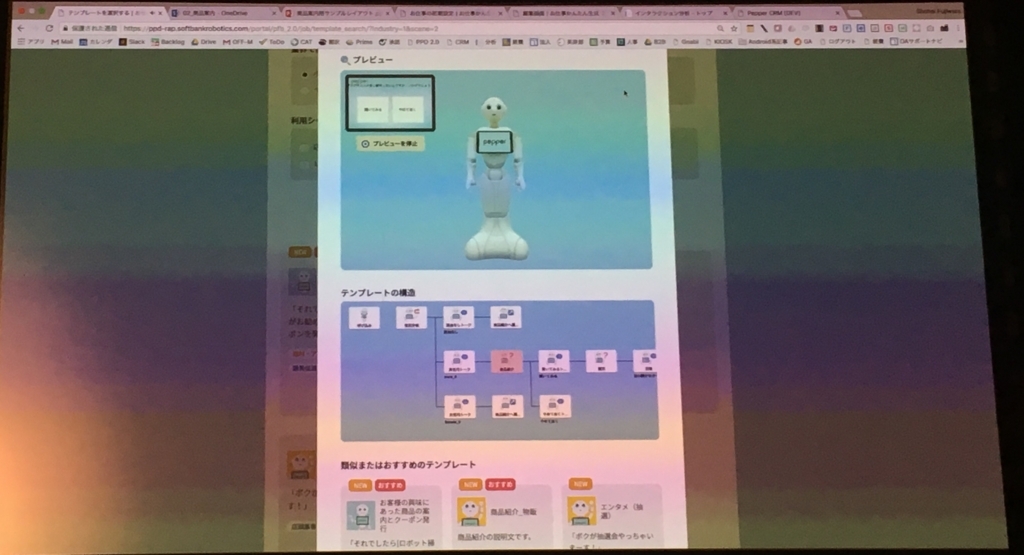

その他、お仕事かんたん生成のシュミレーターが機能アップして3Dとして、pepperの動きを確認できるようになるのもいいですね。

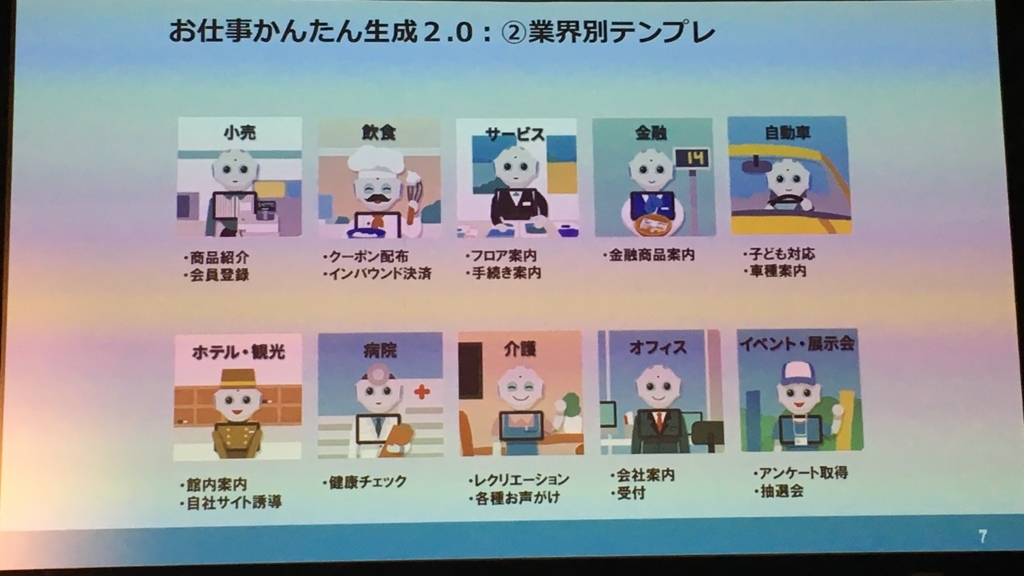

Javaで完全に作り変えたらしく、速度もデモを見る限りかなり速くなっている印象を受けました。シナリオもシーンごとにテンプレートがあるようなので、簡単なものならすぐに作り上げることができそうです。

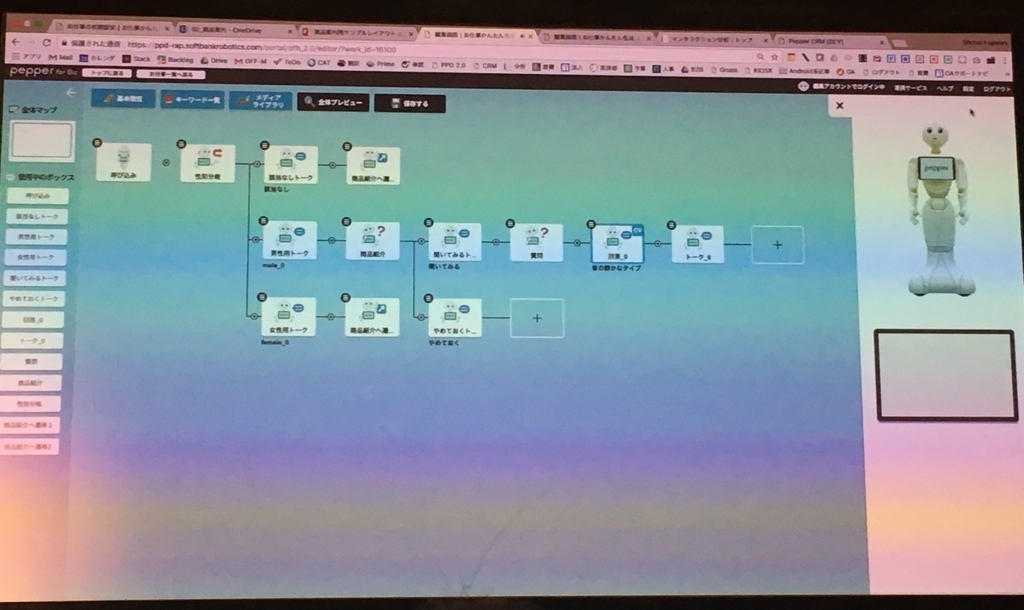

シナリオの作成もこれまでの画面切り替えて1ページずつ作るようなものでなく、フローをペタペタ機能のノードを貼り付けて作っていく形式に変わるのもわかりやすくて良いです。

11/30になったらさっそく使ってみたいと思います。

明日はpepperアプリをもう少し展示会のほうで見てきたいと思います。